Технология

- Главная

- Технология

Исследование OpenAI показало слабую управляемость цепочки мыслей ИИ

OpenAI опубликовала исследование, посвященное контролируемости цепочки рассуждений (Chain of Thought, CoT) у моделей искусственного интеллекта, передает Vesti.az со ссылкой на зарубежные СМИ.

Как сообщает компания, тестирование показало, что современные reasoning-модели пока плохо справляются с управлением собственным ходом рассуждений — даже в случаях, когда знают, что их действия отслеживаются. Максимальный показатель среди протестированных моделей составил лишь 15,4%.

Для эксперимента специалисты OpenAI разработали открытый бенчмарк CoT-Control, включающий более 13 тысяч задач на основе наборов GPQA, MMLU-Pro, HLE, BFCL и SWE-Bench Verified. Каждой задаче добавлялись дополнительные инструкции, касающиеся именно процесса рассуждения — например, не использовать определенное слово, писать только строчными буквами или добавлять заданное слово в конец каждого предложения.

Модель должна была не только правильно решить задачу, но и строго соблюдать ограничения в процессе рассуждений. Однако результаты показали, что системы часто нарушают эти правила, даже осознавая ошибку. В некоторых случаях модели прямо отмечали, что использовали запрещенное слово, но продолжали его применять.

По данным исследования, более крупные модели немного лучше контролируют рассуждения, однако этот эффект может исчезать при увеличении длины рассуждений или после дополнительного обучения с подкреплением. Например, у модели OLMo-3-7B показатель контролируемости снизился более чем в десять раз после RL-обучения.

При этом модели значительно лучше выполняют инструкции в итоговом ответе, чем в самом процессе рассуждения. Это делает нарушения более заметными для систем-наблюдателей, которые анализируют цепочку мыслей ИИ.

Исследование продолжает работу OpenAI по наблюдаемости CoT, опубликованную в декабре 2025 года. Тогда изучался вопрос, может ли отдельная модель-наблюдатель выявлять потенциально опасное поведение ИИ, анализируя его рассуждения. Новая работа показала, что на текущем этапе модели не способны намеренно обмануть такого наблюдателя.

По мнению исследователей, это пока подтверждает эффективность мониторинга цепочки рассуждений как одного из инструментов контроля за поведением искусственного интеллекта. Однако в OpenAI признают, что с ростом масштабов и возможностей моделей ситуация может измениться.

Vesti.az

Аудитория ChatGPT превысила миллиард пользователей за три года

Volkswagen представил спортивный пикап Amarok W600

В Азербайджане представили систему медицинского цифрового двойника

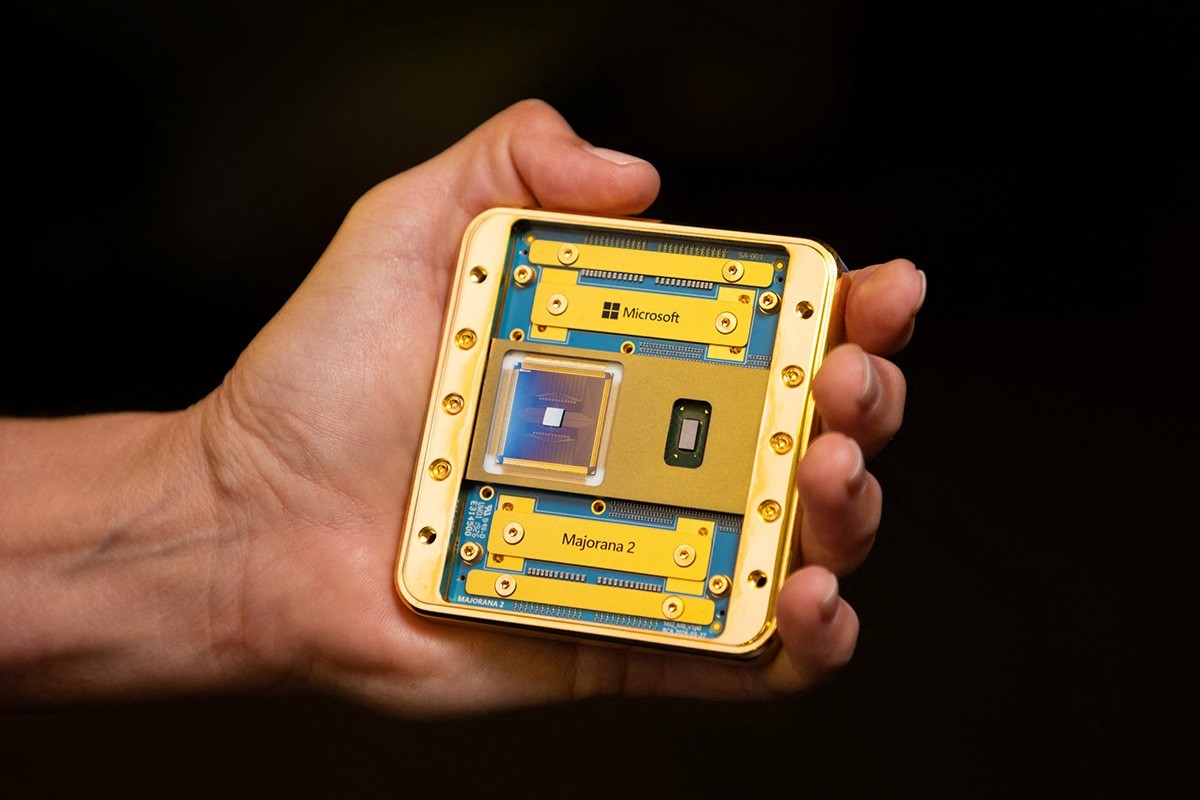

Microsoft представила квантовый чип Majorana 2 для ускорения научных открытий

Базовый Huawei Mate 80 стал самым популярным смартфоном серии

Nvidia представила первые ИИ-ноутбуки нового поколения